AI智能体

大模型应用的安全合规

了解大模型的多种优化方法后,你可能已经准备将其引入到业务中。但在正式应用和上线之前,你应该充分了解引入大模型后可能存在的风险以及应对策略。课程目标学习完本课程后,你将能够:认识大模型的个人信息、内容安全、模型安全和知识产权风险了解大模型的个人信息、内容安全、模型安全和知识产权风险的治理策略了解大模型应用的备案要求和方法1大模型的风险随着生成式人工智能技术的广泛应用,其在保护用户个人

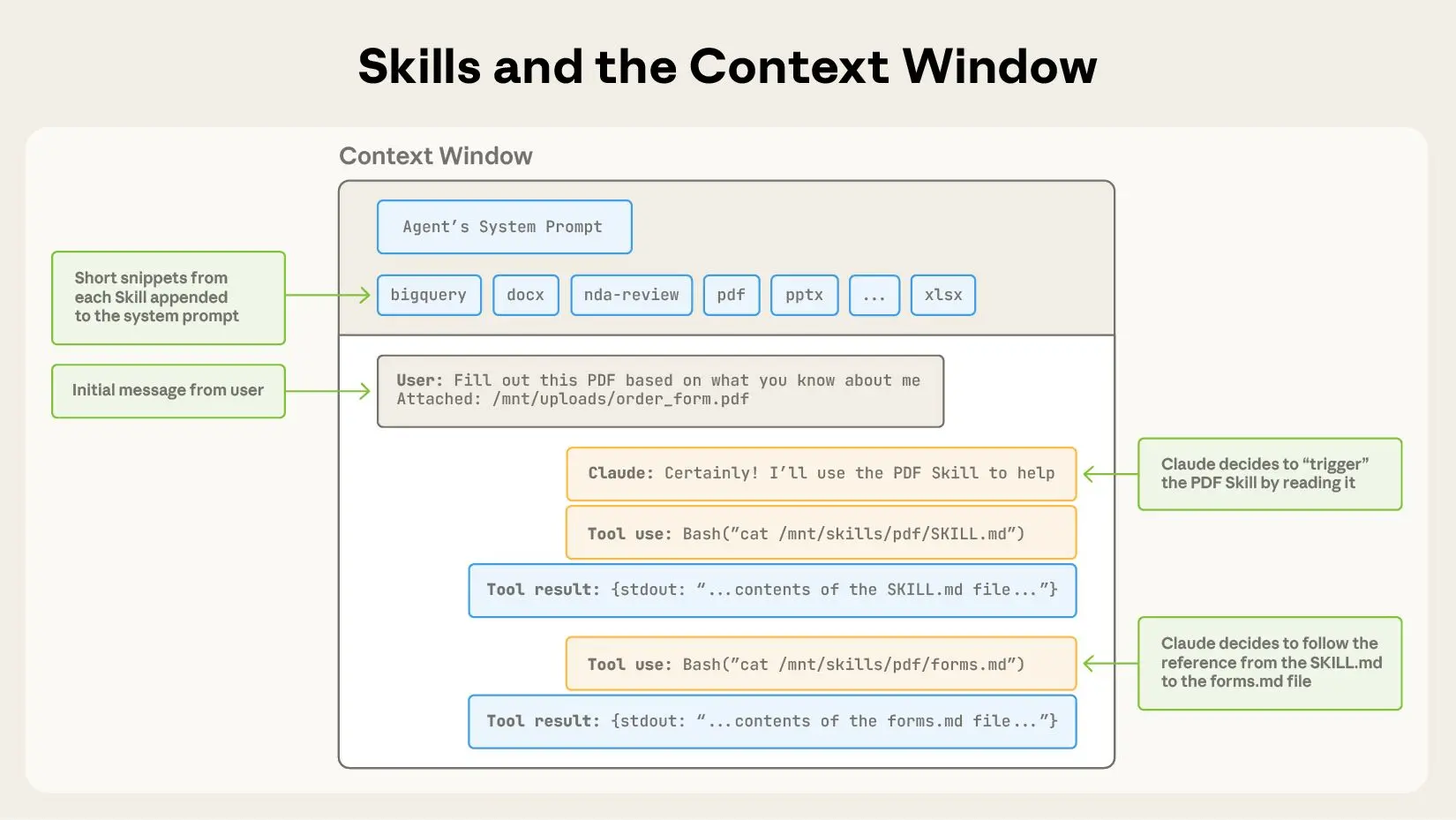

通过RAG增强大模型回答原本无法回答的问题

前言你报名参与了导游志愿者活动,但对景点并不熟悉的你很难给出令游客满意的景点介绍。你意识到可以通过查询资料来帮助你完成导游工作,这时的你不再扮演知识的输出者,而是知识的总结者。同样地,给大模型配备知识库,也可以让它参考查询到的信息回答原本无法回答的问题。这种结合了信息检索与文本生成的方法就是我们本节课程要介绍的检索增强生成(RAG)

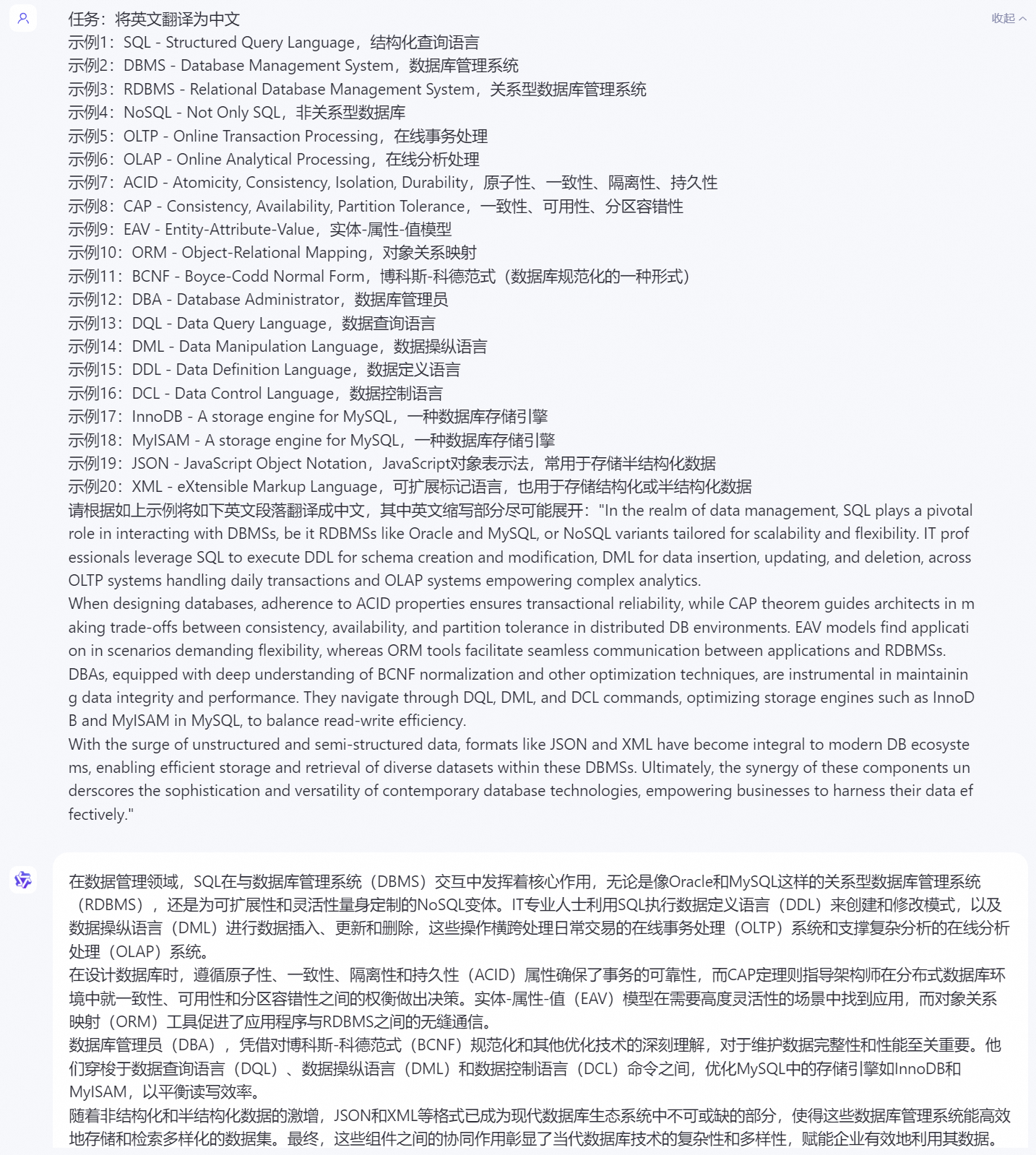

Claude放的大招“Agent Skills”:如何让 Agent 具备真实世界能力?

Anthropic推出的Agent Skills,本质是将“提示词工程”升级为“技能模块化”,让Claude能像人一样按需加载知识。它通过“渐进式披露”机制,解决了AI上下文窗口的Token浪费问题,让通用模型瞬间变身专业领域的“特种兵”。但这看似完美的“技能商店”蓝图,也带来了不容忽视的供应链安全风险。

通过插件增强大模型的能力

你已经熟练使用大模型的;来自动处理各种批量任务。不过,你可能也发现,并不是所有任务大模型都能完美解决。例如,当你给大模型一批小学难度的计算题,比如393乘以285,它竟然给出了错误答案。就像不擅长数学的人可以使用计算器来解决复杂的算术问题一样,大模型也可以借助插件这种工具来解决它原本难以解决的问题。